Eine Zusammenarbeit von PTA und Statista

Diese Blogserie liefert aktuelle Zahlen, Trends und Prognosen zur Nutzung von AI-Technologien in Unternehmen. Mit faktenbasierten Erkenntnissen geben wir fundierte Einblicke, um die neuesten Fortschritte im Bereich AI verständlich und greifbar zu machen. Die Serie entsteht in Kooperation mit Statista.

Agentic AI kann mehr als Antworten geben: KI‑Agenten können Aufgaben planen, Tools nutzen und Prozesse anstoßen. Dadurch entsteht echter Mehrwert – aber auch ein neuer Anspruch an die nötige Infrastruktur. Denn sobald Agenten „handeln“, reichen gute Prompts nicht mehr aus. Jetzt braucht es ein stabiles Datenfundament, klare Spielregeln und gut geschulte Mitarbeitende.1

Kontext statt Bauchgefühl: Wissen muss auffindbar und belastbar sein

Viele Unternehmen haben die nötigen Informationen bereits, sie sind aber auf viele Quellen und Formate verteilt: Richtlinien als PDF, Prozessdetails im Intranet, Stammdaten im ERP, Ausnahmen in E‑Mails. Für Agentic AI ist entscheidend, dass Wissen auffindbar, aktuell und prüfbar ist.

Ein pragmatischer Weg ist „Grounding“ über Retrieval-Augmented Generation. Das System sucht passende Inhalte aus internen Quellen und nutzt diese als Grundlage für Entscheidungen und Antworten. Damit das zuverlässig klappt, müssen Datenquellen gepflegt, strukturiert und der Zugriff sauber geregelt sein.2

Agenten dürfen nicht „alles“: Sichere Tool-Nutzung ist Pflicht

Der größte Unterschied zwischen Chat und Agent ist die Aktion. Ein Agent kann Tickets anlegen, Daten ändern, Bestellungen vorbereiten oder Workflows starten. Deshalb muss früh geklärt werden: Welche Tools darf der Agent nutzen? Mit welchen Rechten? Und wann braucht es eine Freigabe?

Hilfreich ist hier ein einfaches Scoping. Wie viel Kontrolle hat das Unternehmen über Modell, Daten und Anwendung und welche Sicherheitsmaßnahmen leiten sich daraus ab? AWS bietet dafür eine Scoping‑Matrix als Orientierung (von „externer Dienst“ bis „eigene Modelle“). Das ist praktisch, weil es Security‑Aufwand und Verantwortlichkeiten greifbar macht bevor man skaliert.3

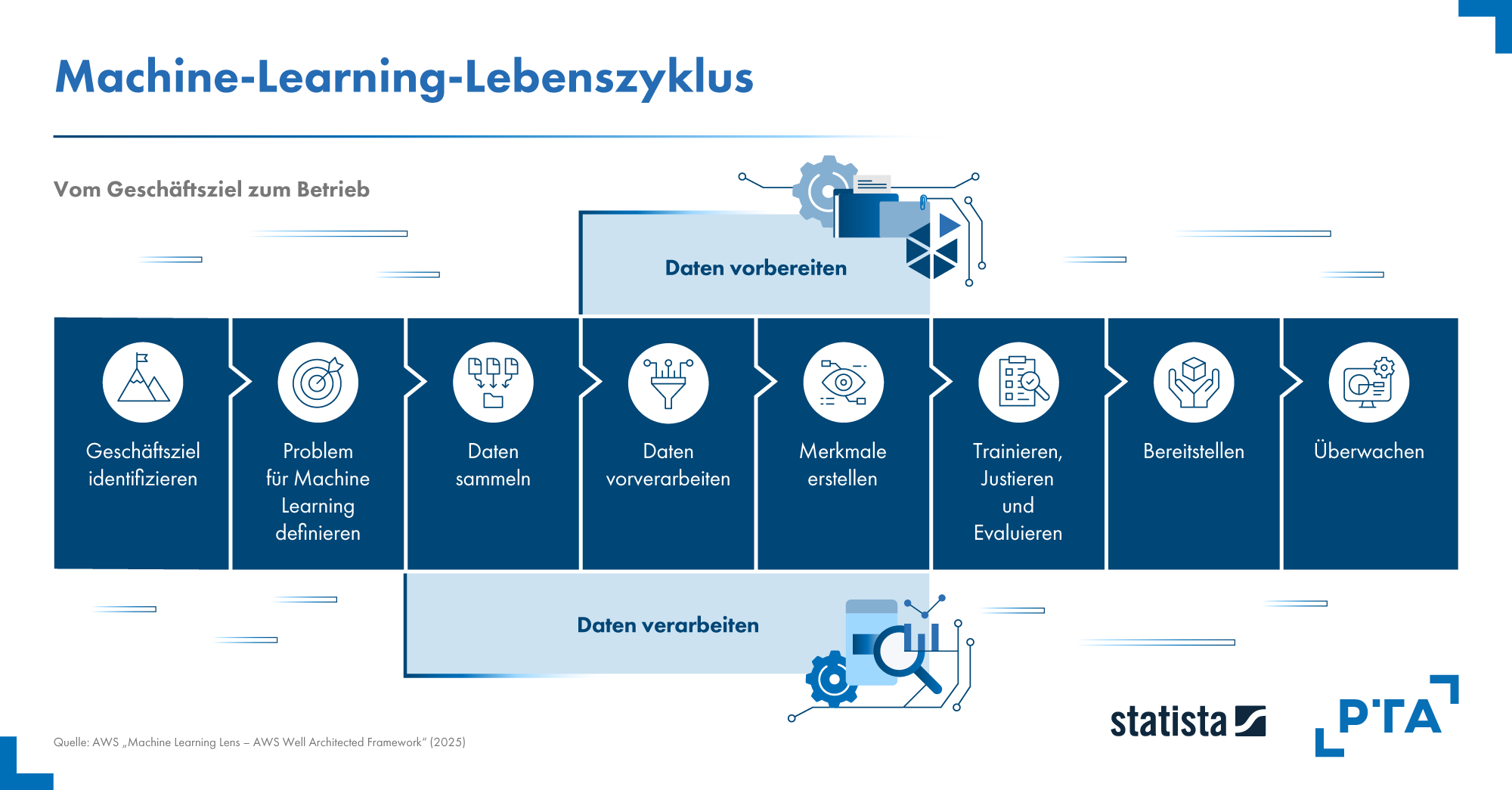

Datensammlung und -verarbeitung für Maschinelles Lernen4

Verantwortung sichtbar machen: Regeln, Nachweise, klare Zuständigkeiten

Sobald Agenten in Kernprozessen mitlaufen, entstehen typische Fragen aus Management‑ und Compliance‑Sicht. Wer verantwortet den Use Case? Wie wird dokumentiert? Wie gehen wir mit Risiken um? Und wie zeigen wir das im Audit? Hier helfen etablierte Orientierungspunkte. NIST hat ein Profil für generative KI veröffentlicht, das typische Risiken und Gegenmaßnahmen entlang des Lebenszyklus strukturiert. Der Standard ISO/IEC 42001 beschreibt, wie Organisationen ein Managementsystem für KI aufsetzen, betreiben und kontinuierlich verbessern können. Beides ist weniger „Theorie“, sondern eine gute Checkliste, um Verantwortlichkeiten und Mindeststandards sauber aufzusetzen.4,6,7

Betrieb statt Experiment: Messen, testen, überwachen

KI-Systeme liefern nicht immer identische Ergebnisse. Ein einmaliger Test reicht daher nicht aus. Unternehmen brauchen klare Abläufe, um Qualität und Betrieb dauerhaft im Blick zu behalten.

KI-Agenten können je nach Aufgabe unterschiedliche Werkzeuge auswählen, Schritte parallel ausführen und ihr Vorgehen iterativ anpassen. Dadurch steigen die Anforderungen an Transparenz: Es muss nachvollziehbar bleiben, welche Entscheidungen getroffen werden, welche Tools zum Einsatz kommen und wie sich das Verhalten über die Zeit verändert.

Praxisleitfäden empfehlen deshalb, KI wie andere Unternehmenssoftware zu betreiben – mit klaren Test-, Änderungs- und Überwachungsprozessen, damit auch bei wachsender Autonomie die Kontrolle erhalten bleibt.2,3,5

Erst das Fundament – dann die Autonomie

Agentic AI entfaltet Wirkung, wenn sie sicher in die Unternehmens‑IT eingebettet ist: mit guter Wissensbasis, klaren Zugriffsrechten, nachvollziehbaren Regeln und einem Betrieb, der Qualität und Kosten im Griff hat. Wer diese Grundlagen früh setzt, bringt Agenten schneller aus dem Pilot heraus und reduziert spätere Nacharbeit und Risiko deutlich.

¹ OpenAI „A practical guide to building agents“ (PDF) (2025): Muster, Best Practices und Guardrails für Agenten (inkrementeller Aufbau, sichere Ausführung). OpenAI.

² Google Cloud „Deploy and operate generative AI applications“ (2024): Betrieb, Deployment und Prozesse für produktive GenAI Anwendungen (DevOps/MLOps Adaption). Google Cloud.

³ Microsoft „AI workloads on Azure – Azure Well Architected Framework“ (2024/2025): Architektur und Betriebsleitlinien für AI Workloads (Design, Operations, Testing/Evaluation). Microsoft Learn.

⁴ AWS „Machine Learning Lens – AWS Well Architected Framework“ (2025): Best Practices für Aufbau und Betrieb von ML/AI Workloads über den Lebenszyklus. AWS.

⁵ AWS „Generative AI Security Scoping Matrix“ (laufend): Orientierung zur Einordnung von GenAI Use Cases und Ableitung passender Sicherheitskontrollen. AWS.

⁶ NIST „AI RMF: Generative AI Profile“ (NIST AI 600 1) (2024): Risiken und Gegenmaßnahmen für GenAI entlang des Lebenszyklus. NIST.

⁷ ISO/IEC 42001:2023 (2023): Anforderungen an ein AI Managementsystem (AIMS) zum Aufbau, Betrieb und zur kontinuierlichen Verbesserung von KI in Organisationen. ISO.